Google dio a conocer Gemini Intelligence, una herramienta avanzada de inteligencia artificial integrada en Android que busca transformar la manera en que los usuarios interactúan con sus dispositivos móviles. Esta innovación supera la simple generación de imágenes o emojis, concentrándose en automatizar tareas específicas y facilitar el manejo diario de aplicaciones.

Entre las funcionalidades principales, Gemini Intelligence podrá leer el contenido visible en pantalla y responder con acciones concretas dentro del dispositivo. Por ejemplo, interactuará con aplicaciones populares para reservar servicios o realizar compras, como añadir productos a un carrito o gestionar información presente en correos electrónicos y notas. Además, integrará un asistente para la navegación en Google Chrome y mejorará el teclado Gboard para que el usuario convierta su voz en texto de manera más fluida.

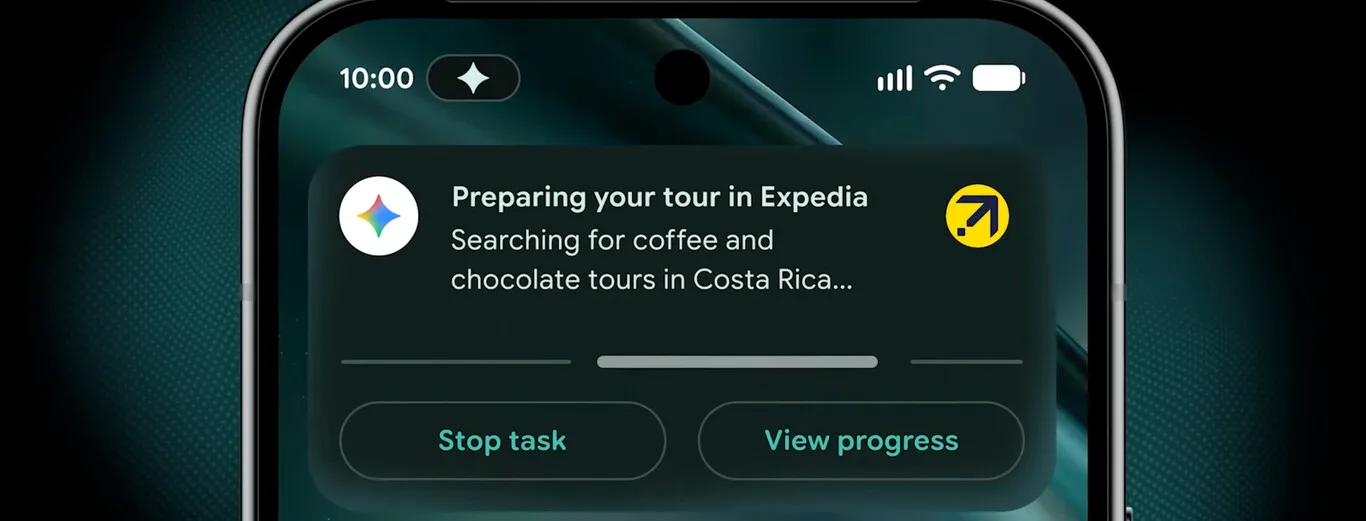

La automatización no se limita a respuestas informativas, sino que pretende ejecutar procesos complejos. Google mostró ejemplos concretos como reservar una bicicleta para una clase o planear un tour turístico a partir de una fotografía del cartel del evento. Para activar estas funciones, basta con mantener pulsado el botón de encendido y dar instrucciones por voz, lo que simplifica la experiencia y ahorra tiempo al usuario.

Respecto a su disponibilidad, Gemini Intelligence estará reservado para los dispositivos Android más avanzados. La implementación comenzará en teléfonos Samsung Galaxy y Google Pixel compatibles, con un despliegue previsto para este verano. Más adelante, hacia fin de año, la tecnología se expandirá a otros dispositivos como relojes inteligentes, automóviles, gafas de realidad aumentada y laptops, ampliando el ecosistema de interacción inteligente dentro de Android.